AIクローラーが一番アクセスするのはどこか—ログで見えた3つの入口と確認方法

AIクローラーがサイトに来たとき、記事本文より先に必ず確認しに行くURLがあります。複数サイトのサーバーログを集計したところ、robots.txt・sitemap・llms.txtの3か所へのアクセスが、全クロールの95%以上を占めていました。

ジャンルも規模もまったく異なるサイト同士で、同じ傾向が確認できています。つまりこの3つの設定が正しく機能していなければ、AIクローラーは記事本文にたどり着く前に迷子になります。逆に言えば、3つを整えるだけでAIへの可視性はかなり変わります。

設定方法と、正しく動いているかの確認方法をまとめました。

この記事でわかること|📖:約5分

- AIクローラーが最初に確認しに来る3つのURLとその理由

- robots.txt・sitemap・llms.txtそれぞれの役割と基本設定

- 設定が正しく機能しているかの確認方法

- 3つを一括でチェックできる無料ツールの使い方

AIクローラーのアクセスの6割は記事本文ではない

複数サイトのサーバーログを確認したところ、どのサイトでも同じ傾向が見られました。AIクローラーのアクセスのうち、約6割がrobots.txt・sitemap・llms.txtの3ファイルに集中していて、記事本文へのアクセスは残りの4割程度でした。

つまりAIクローラーは、コンテンツを読みに来る前に「このサイトはどんな構造か」「どこに何があるか」を確認する動作を繰り返しています。入口ファイルの設定が正しくなければ、記事本文にたどり着く前に迷子になる可能性があります。

以降では、3つの入口ファイルそれぞれの役割と基本設定を順番に見ていきます。

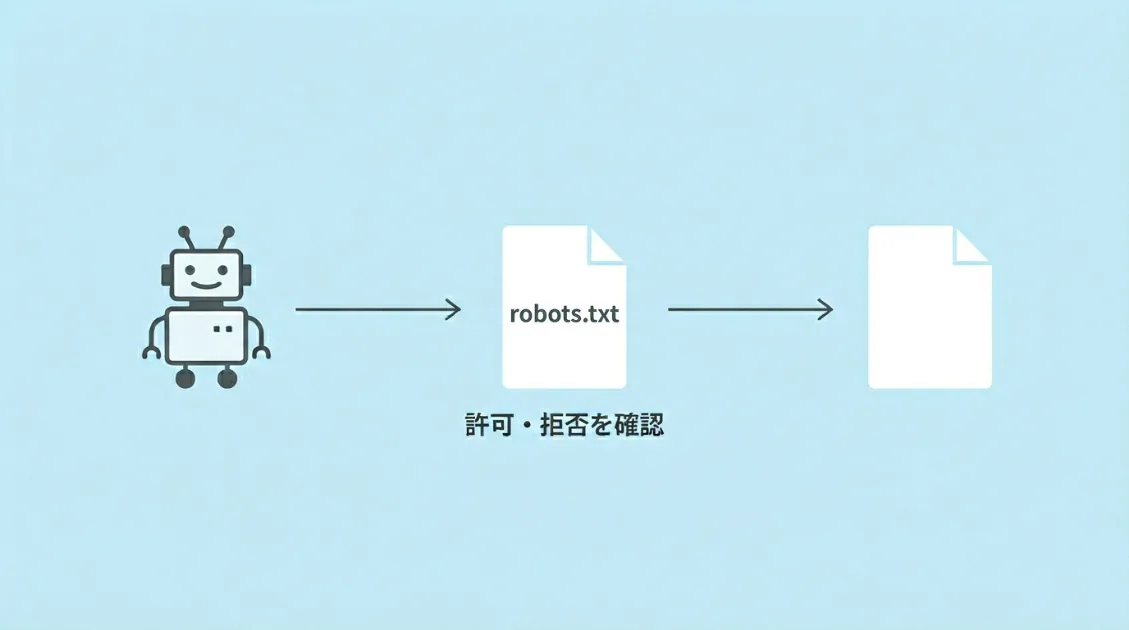

入口①:robots.txt

robots.txtは、AIクローラーに対して「このサイトのどこを読んでいいか」を伝えるファイルです。サイトのルートURL直下(例:https://example.com/robots.txt)に置くだけで機能します。

複数サイトの観測では、robots.txtへのアクセスが3ファイルの中で最も多く、全体の半数以上を占めていました。ClaudeBotやPerplexityBotはサイトに来るたびに必ずrobots.txtを確認しています。

基本の書き方

WordPressサイトであれば、最低限この形が入っていれば問題ありません。

User-agent: *

Allow: /

User-agent: GPTBot

Allow: /

User-agent: ClaudeBot

Allow: /

User-agent: PerplexityBot

Allow: /

Sitemap: https://あなたのドメイン/sitemap_index.xmlUser-agent: *で全クローラーに許可を出しつつ、主要なAIクローラーを個別に明示するのが確実です。最終行にSitemapのURLを書いておくと、robots.txtを読んだクローラーがそのままsitemapに進みやすくなります。

確認方法

ブラウザで https://あなたのドメイン/robots.txt にアクセスして、テキストが表示されれば設置済みです。何も表示されない・404になる場合は未設置か設置場所が間違っています。

robots.txtの詳しい設定については robots.txtでAIクローラーを制御する にまとめています。

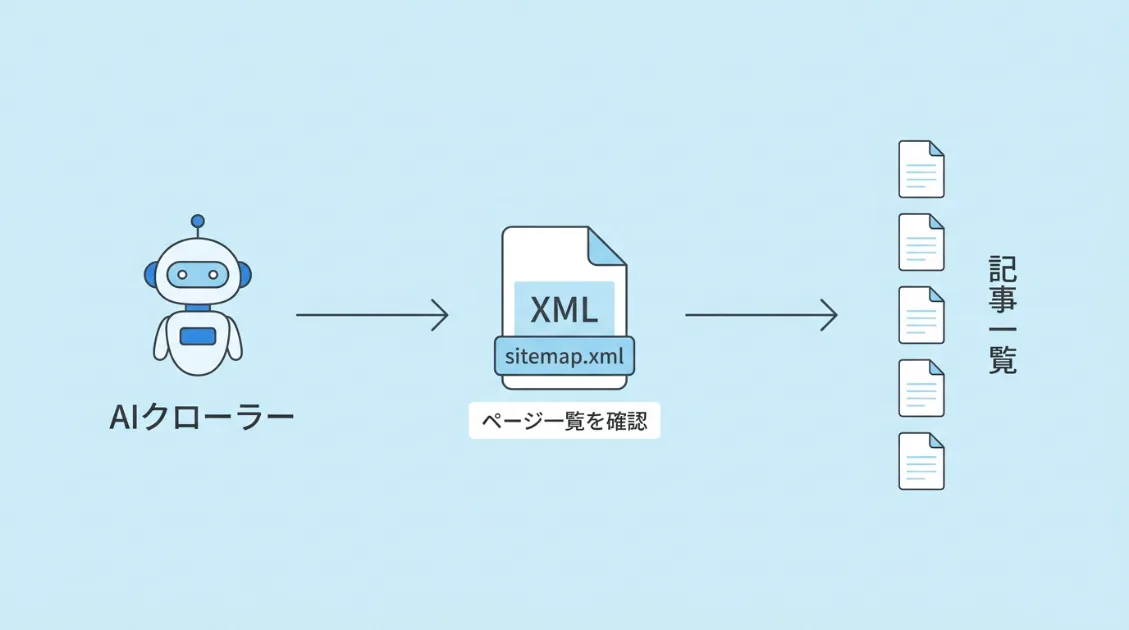

入口②:sitemap

sitemapは、サイト内にどんなページがあるかをAIクローラーに伝えるファイルです。robots.txtを読んだクローラーが次に確認しに来る場所で、観測期間中も robots.txt の次に多くのアクセスが集まっていました。

WordPressの場合、Yoast SEOやAll in One SEOを使っていれば自動生成されています。ブラウザで https://あなたのドメイン/sitemap_index.xml にアクセスして内容が表示されれば問題ありません。

基本の確認ポイント

sitemapで確認しておきたいのは3点です。robots.txtの最終行にsitemapのURLが記載されているか、sitemapに重要な記事が含まれているか、noindexのページがsitemapに混入していないかを確認してください。

確認方法

ブラウザで https://あなたのドメイン/sitemap_index.xml または /sitemap.xml にアクセスして、記事のURLが一覧で表示されれば設置済みです。

WordPressのサイトマップとAIクローラーの関係については WordPressのsitemapはAIクローラーに届いているか にまとめています。

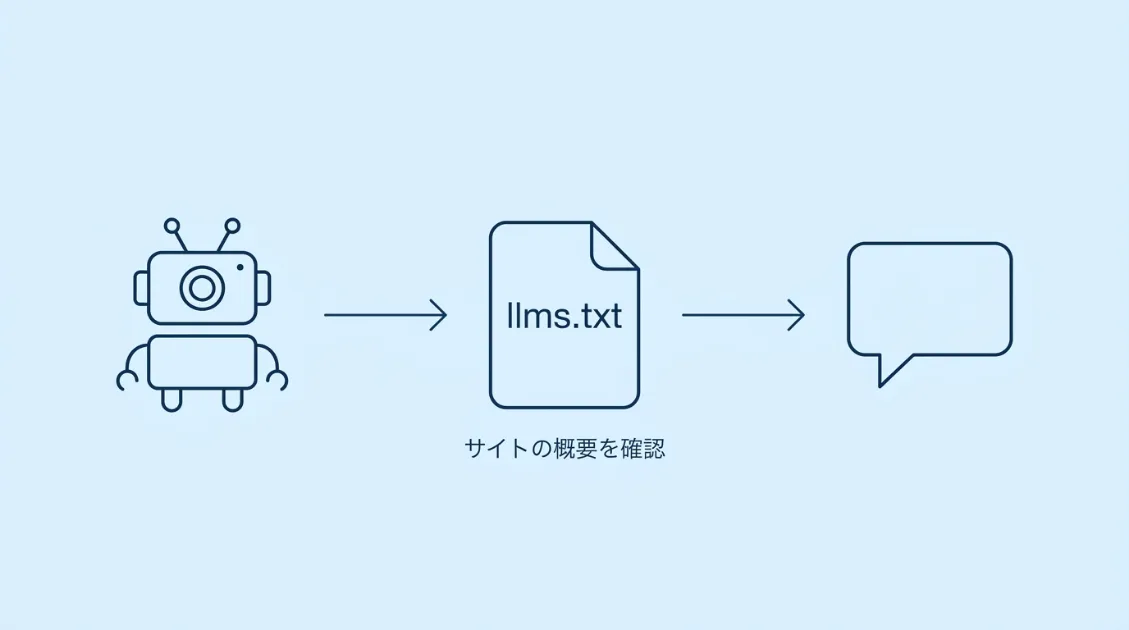

入口③:llms.txt

llms.txtは、AIクローラーに対して「このサイトは何のサイトで、どのページが重要か」を伝えるファイルです。robots.txtやsitemapと違い、まだ標準化はされていませんが、導入コストがほぼゼロなので設置しておいて損はありません。

ただし現実は厳しくて、複数サイトの観測ではllms.txtへのアクセスは全体の数%程度でした。ClaudeBotが稀に読みに来る程度で、GPTBotやPerplexityBotはほぼ無視しています。llms.txtを設置し7日間のサーバーログを見たが、AIクローラーは誰も読んでいなかったで詳しく検証しています。

基本の書き方

サイトのルート直下に llms.txt というファイル名で設置します。中身はシンプルなMarkdown形式で大丈夫です。

# サイト名

> サイトの一言説明

## 重要なページ

- [記事タイトル](https://あなたのドメイン/記事URL/)

- [記事タイトル](https://あなたのドメイン/記事URL/)

確認方法

ブラウザで https://あなたのドメイン/llms.txt にアクセスして内容が表示されれば設置済みです。llms.txtの詳しい書き方は llms.txtの書き方 にまとめています。

3つをまとめて確認できるツール

robots.txt・sitemap・llms.txtを個別にブラウザで確認するのは手間がかかります。AI観測ラボが提供している無料ツールを使うと、URLを1つ入力するだけで3つを一括で取得・確認できます。

登録不要・無料にて、取得した内容をそのまま編集してダウンロードすることも可能です。

まとめ

AIクローラーは記事本文より先に、robots.txt・sitemap・llms.txtの3か所を確認しています。複数サイトの観測で、AIクローラーのアクセスの約6割がこの3ファイルに集中していました。

3つの役割をおさらいすると、robots.txtは「どこを読んでいいか」、sitemapは「どこに何があるか」、llms.txtは「このサイトは何のサイトか」をAIに伝えるファイルです。

設定できているか不安な方は、チェッカーツールで確認してみてください。

あなたのサイトは、

AIに見えていますか?

URLを入力するだけで30秒。8項目を自動診断し、優先度別の改善プランを提示します。完全無料・登録不要。