AIはなぜあなたのサイトを信頼できると判断するのか|DCTAフロー Trustフェーズ

突然ですが、質問です。

ChatGPTやPerplexityに「米粉パンのおすすめを教えて」と聞いたとき、毎回同じサイトが出てくる——そんな経験はありませんか?

試しに何度聞いても、質問の仕方を少し変えても、出てくるサイトの顔ぶれがほぼ変わらない。

これ、偶然じゃないんです。

前回の記事(DCTAフロー・Compareフェーズ)では、AIが複数のサイトを比較して引用先を選ぶ仕組みを見てきました。

今回はその先の話です。

比較されて選ばれた——でもなぜそのサイトが「また」選ばれるのか。AIはどうやって「このサイトは信頼できる」と判断しているのか。

ここからはっきり言っておきます。Trustフェーズだけは、AIの内側の話です。

DiscoverフェーズもCompareフェーズも、人間の行動とAIの動きをセットで観測できました。でもTrustフェーズは違う。AIが何を根拠に「信頼できる」と判断しているか、外から完全に確認する方法が今のところありません。

だからこの記事は、観測データと仮説をベースに書いています。「こうなっているはず」ではなく「こうなっている可能性がある」というトーンで読んでください。

1. 「AI信頼スコア」は存在するのか

AIが「このサイトは信頼できる」と判断するとき、どこかに点数がついているイメージがありませんか?

例えばGoogleなら、被リンクの数や質をもとにした「ページの権威性」がスコアとして存在していました。だからSEOの世界では「被リンクを増やせば順位が上がる」という、ある程度わかりやすい指標があった。

ではAIに同じような「信頼スコア」はあるのか。

結論から言うと、外からは確認できません。

考えられる可能性は2つあります。

ひとつは、信頼性の判断が「この質問への回答としてどれだけ関連性があるか」というスコアの中にすでに溶け込んでいるケース。独立した信頼スコアが存在するのではなく、関連性の判断の中に信頼性も含まれている、という考え方です。

もうひとつは、AIの種類によって仕組みが違うケースです。

ChatGPTやClaudeのような学習データをベースに答えるAIは、学習した時点で「このサイトは信頼できる」という重み付けがすでに焼き込まれている可能性があります。つまり信頼の判断はリアルタイムで起きているのではなく、学習済みの状態として存在している。

一方、PerplexityやGeminiのようにリアルタイムでウェブを見に行くAIは、クロールした時点のシグナル——著者情報、更新頻度、他のサイトからの言及数——を動的に使っている可能性があります。

どちらが正しいかは、今のところわかりません。ただ確かなのは、Googleのように「被リンクを増やせば信頼される」というシンプルな方程式は、AIには通用しないということです。

では実際に何が起きているのか。観測から見えてきたのが「AIの引用常連リスト」という概念です。

2. AIの引用常連リストの形成と固定化

少し実験してみてください。

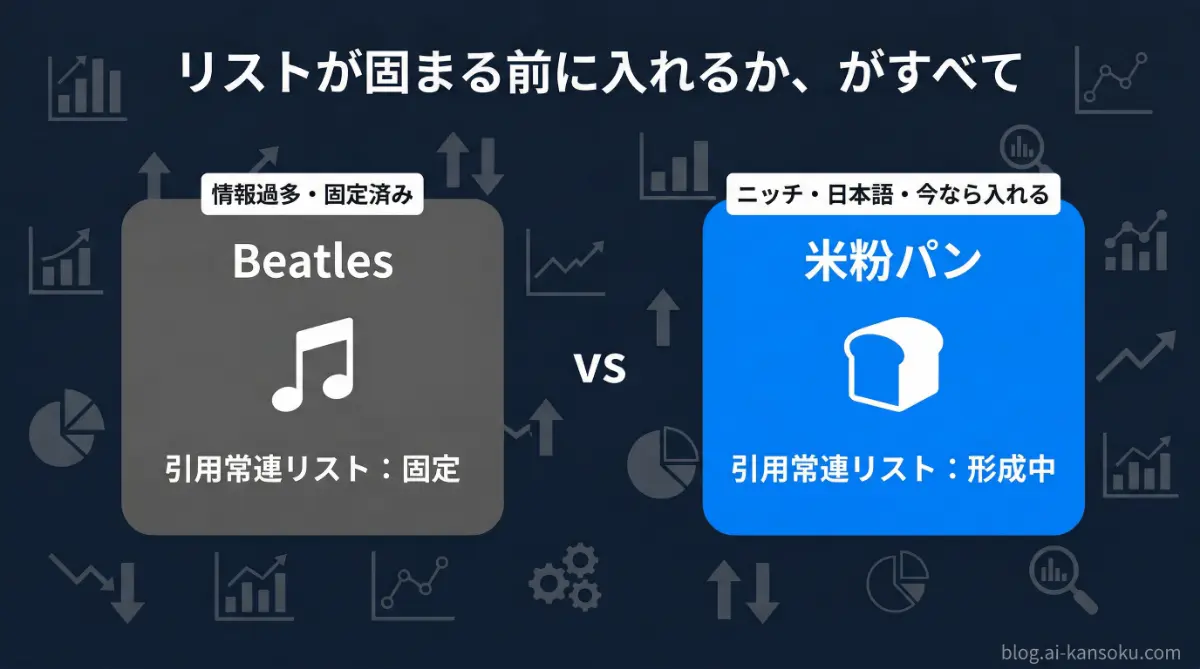

ChatGPTやPerplexityに「ビートルズのおすすめアルバムを教えて」と聞いてみる。次の日も同じことを聞く。1週間後も聞く。

おそらく、出てくる情報源の顔ぶれはほぼ変わりません。

これは当たり前に見えて、実はそうじゃない。ビートルズについて書いているサイトは世界中に無数にあります。それなのになぜ、AIは毎回同じサイト群を参照するのか。

観測から見えてきた仮説は、AIには「引用常連リスト」のようなものが存在するということです。

あるトピックについて、AIが「このサイト群を参照する」というパターンが一度固まると、それが更新されにくくなる。新しいサイトが登場しても、良いコンテンツを書いても、そのリストに入れない可能性がある。

もう少しわかりやすい例で考えてみます。

「米粉パンのおすすめを教えて」とAIに聞いたとします。米粉パンはビートルズと違って、まだ情報量が少ない分野です。日本語で書かれた専門的な記事はさらに少ない。

この状態でAIはどうするか。とりあえず存在する情報源からリストを作る。そしてそのリストが、一度固まってしまう。

つまり引用常連リストが固まる「前」に入れるかどうかが、その後ずっと参照されるかどうかの分岐点になっている可能性があります。

後から良いコンテンツを書いても、リストがすでに固まっていれば入れない。逆に言うと、リストが固まる前の分野であれば、今から動くことに大きな意味がある。

これ、どこかで聞いたことがある話ではないですか?

3. これ、SEOの先行者利益と同じじゃないか

そうなんです。本質的には同じ話です。

SEOの世界にも「先行者利益」という概念がありました。早く記事を書いたサイトが被リンクを集めて、権威性が積み上がって、後発が追いつけなくなる。

AIの引用常連リストも、構造は似ています。早くリストに入ったサイトが参照され続けて、後から入ろうとしても固定化されていて入れない。

ただ、一つだけ大きく違うところがあります。

SEOは後発でも逆転できました。より良いコンテンツを書いて、被リンクを積み上げれば、時間はかかっても順位を上げられた。Googleは定期的にアルゴリズムを更新して、評価を見直してくれた。

でもAIの引用常連リストは、逆転の機会自体が少ない可能性があります。

Googleのように「このサイトの評価を上げました」という明示的なシグナルがない。学習データ系のAIであれば、次の学習タイミングまでリストが更新されないかもしれない。リアルタイム系のAIでも、一度固まったパターンがどれだけ柔軟に変わるのか、外からは見えない。

レガシーな概念ではあるけれど、AIの場合はその固定化がより強く、より早く起きる可能性がある。

だとすれば「まだ固まっていない分野を見つけること」が、今この瞬間にできる一番現実的な動きかもしれません。

では、固まりやすい分野と固まりにくい分野は何で決まるのか。

4. トピックの性質とレイヤーで難易度が変わる

引用常連リストへの参入難易度は、トピックによって全然違います。

ビートルズで考えてみます。

ビートルズについての情報は英語・日本語問わず膨大にあります。大手音楽メディア、Wikipedia、専門書のデジタル版——すでにリストが何重にも固まっている状態です。今から「ビートルズの解説記事」を書いても、そのリストに入れる可能性はほぼない。

では米粉パンはどうか。

ビートルズに比べ書かれた専門的な記事はまだ少ない。製法の違い、産地別の特徴、グルテンフリーとの関係——深く掘り下げたコンテンツがほとんど存在しない分野です。リストがまだ固まりきっていない。今から動けば、核になれる可能性がある。

この違いを生む要因は2つあります。

ひとつは情報量とトピックの規模。ビッグトピックはすでに情報が飽和していて、参入には網羅性と独自の角度が必要です。ニッチなトピックはまだ空白が多い。

もうひとつは言語の壁。日本語という条件が加わると、競合の絶対数がさらに減ります。英語圏では飽和していても、日本語ではまだリストが形成途中という分野が山ほどある。専門性が高い分野ほど、この傾向は強い。

さらにもう一つ、見落とされがちな視点があります。同じトピックの中でも、レイヤーによって固定化の速度が違うということです。

例えば米粉パンで整理するとこうなります。

| レイヤー | 例 | 固定化の速度 |

|---|---|---|

| 一次情報 | 農水省のデータ、製粉会社の公式情報 | 新情報が出るたびに更新される |

| 考察レイヤー | 栄養士・パン職人の深掘りブログ | まだ薄い、今なら入れる |

| まとめレイヤー | 「米粉パンおすすめ10選」系 | 固まりやすく外れにくい |

一次情報は鮮度が命なので、新しい公式データが出れば入れ替わります。まとめレイヤーはわかりやすさが評価されやすく、一度入ったら固定化しやすい。そして考察レイヤーが一番空白が多い。独自の視点や検証データを持っているサイトが、今最も参入しやすいレイヤーかもしれません。

ただ、ここで一つ大きな問題があります。

自分のサイトが引用常連リストに入れているかどうか、確認する方法がないのです。

5. 引用常連リストに入れたか確認する方法がない問題

ここが現時点での一番の課題です。

AIクローラーが来ているかどうかは、ある程度観測できます。サーバーログを見れば、GPTBotやClaudeBotがクロールしたかどうかはわかる。

でも「クロールされた」と「引用常連リストに入った」はイコールじゃありません。

来たけど入れなかった、という可能性が普通にある。

では確認する方法はあるのか。今のところ現実的な手段は一つだけで、実際にAIに聞いてみるしかありません。

例えば「米粉パンのおすすめサイトを教えて」とPerplexityに聞いて、自分のサイトが出てくるか確認する。質問の仕方を変えて何パターンか試す。複数のAIで同じことをやってみる。

ただこれには問題があって、再現性が低いんです。

同じ質問でも、聞くタイミングや細かい言い回しで結果が変わることがある。「今日は出てきた、明日は出てこなかった」という状況が起きる。システマチックに確認する方法として、まだ信頼性が高いとは言えません。

SEOにはGoogle Search Consoleという公式ツールがあって、自分のサイトがどのキーワードで表示されているか確認できました。でもAIの引用に関しては、そういったツールが現時点では存在しない。

これはAI検索最適化における、今一番大きな「見えない壁」だと思っています。

対策を打っているつもりでも、それが効いているのかどうかフィードバックが返ってこない。効果測定ができない状態で動き続けるしかない。

だからこそ、AI観測ラボとして次に作りたいものがあります。

6. 将来的に作りたいもの

「自分のサイトがAIの引用常連リストに入っているか確認できるツール」——これをAI観測ラボとして作りたいと思っています。

イメージしているのは、AIのAPIを使って複数の質問パターンを自動で投げて、自分のサイトが引用されるかどうかを疑似的に確認できる仕組みです。

1回聞くだけでは再現性が低い。でも100パターンの質問を自動で投げて、そのうち何回引用されたかを集計できれば、ある程度の傾向は見えてくるはずです。

完全な正解は出せません。AIの内側は見えないので、あくまで「疑似的な確認」になります。でも今のように「まったく見えない」状態よりは、意思決定の根拠になるデータが得られる。

まだ構想段階ですが、AI観測ラボの次のステップとして取り組んでいきます。

できたときはこのブログで報告します。

7. まとめ:Trustフェーズで言えること・言えないこと

Trustフェーズは、DCTAフローの中で一番「わからない」が多いフェーズです。

右往左往したので一旦、整理します。

現時点で言えること

AIには「引用常連リスト」のようなものが存在する可能性がある。一度リストが固まると更新されにくく、後から入るのが難しくなる。これはSEOの先行者利益と本質的には同じ構造だが、固定化がより強く早く起きる可能性がある。

そしてニッチな分野×日本語という条件では、リストがまだ固まっていない空白が多く残っている。特に考察レイヤーは今が一番入りやすいタイミングかもしれない。

現時点で言えないこと

信頼スコアが独立して存在するのかどうか。引用常連リストに入れたかどうかを確認する方法。そして一度入ったリストから外れる条件。

これらはまだ観測できていません。

「わからない」をわからないまま書くのが、AI観測ラボのスタンスです。仮説が外れたときも、そのまま記録します。

次のAフェーズでは「AIが行動を後押しする場面」を見ていきます。DiscoverからTrustまで積み上げてきた話が、最終的にどう「行動」につながるのか。引き続き観測を続けます。

公開日:2026年2月 / 著者:冨島 基宏(AI観測ラボ)

関連記事

あなたのサイトは、

AIに見えていますか?

URLを入力するだけで30秒。8項目を自動診断し、優先度別の改善プランを提示します。完全無料・登録不要。