AIのハルシネーションとは?ChatGPT・Gemini・Perplexityで実測してわかった精度の差

「AI観測ラボとはどんなサイトですか?」

ChatGPT・Perplexity・Geminiの3つに、同じ質問を投げかけました。返ってきた答えは三者三様——正確に説明したものもあれば、存在しない機能を堂々と語ったものも、実態とまったく異なるサイト像を作り上げたものもありました。

AIの回答は、なぜ食い違うのか。引用元があれば信頼できるのか。サイトを運営している側から見ると、何が怖いのか。

実測データをもとに、整理していきます。

この記事でわかること|📖:約8分

- AIがなぜ間違えるのか——ハルシネーションの仕組みを中学生向けに解説

- ChatGPT・Perplexity・Geminiの「正確さ」の違いと、実際に試してわかったこと

- 「引用元があれば安全」が必ずしも正しくない理由

- サイト運営者がハルシネーションで受ける具体的なリスク

そもそもAIはなぜ間違えるのか

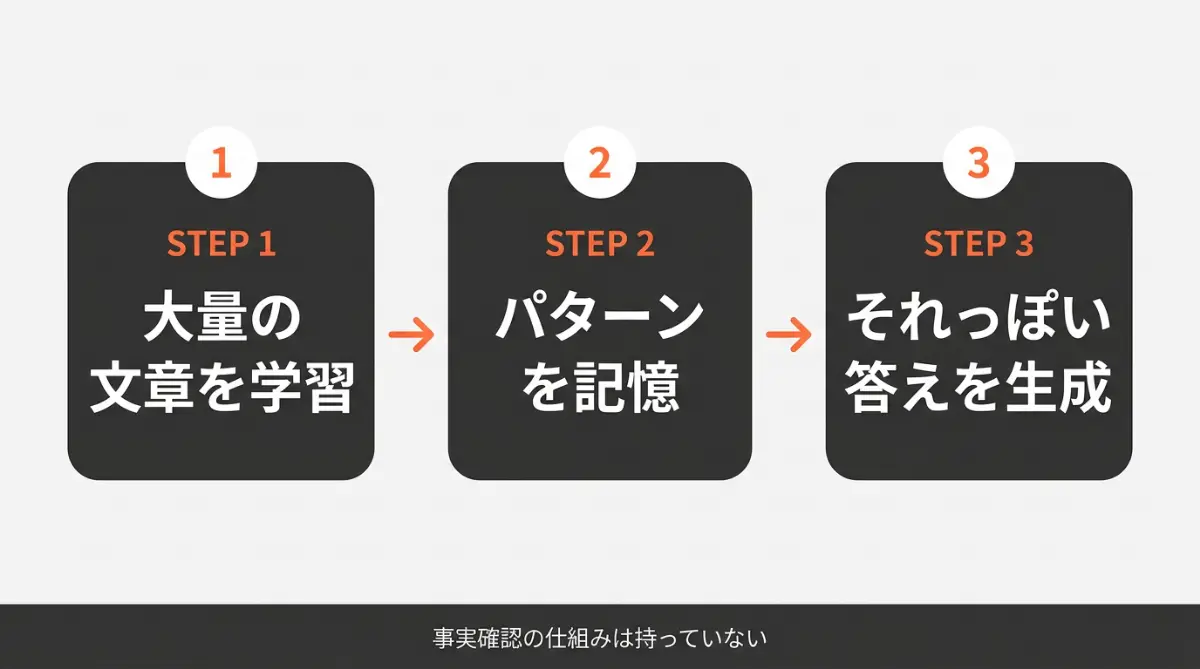

AIは「知っていること」を答えているわけではありません。

正確に言うと、AIは大量の文章を読み込んで「次にどんな言葉が来そうか」を予測しながら文章を組み立てています。人間のように「これは事実か」を確認する仕組みは、基本的に持っていません。

たとえるなら、膨大な本を読んだ人が「~っぽい答え」を作り上げているイメージです。ほとんどの場合は正確ですが、知識の穴があるところでは、自信満々に間違いを言ってしまうことがあります。

この現象をハルシネーション(hallucination)と呼びます。日本語にすると「幻覚」です。AIが存在しない情報や、事実と異なる内容を、もっともらしい文章で出力してしまう状態を指します。

ハルシネーションが起きやすいのは、主に次のような場面です。

- 学習データに含まれていないニッチな情報を聞いたとき

- 最新の出来事や、公開後に変わった情報を聞いたとき

- 固有名詞(人名・サイト名・会社名など)の詳細を聞いたとき

今回AI観測ラボについてGeminiに聞いたところ、「AIの最新ニュースを速報するメディア」という、まったく異なるサイトの説明が返ってきました。観測期間中、Geminiは「AI観測ラボ」という名前だけをもとに、それらしいサイト像を作り上げていたと考えられます。

ハルシネーションの怖さは、間違いが「間違いっぽく見えない」点にあります。丁寧な文体で、箇条書きで整理されて出てくるため、読んだ側が疑いを持ちにくい状態になります。

各AIの特徴と信頼性の違い

一口に「AI」と言っても、回答の作り方はサービスによって大きく異なります。ChatGPT・Perplexity・Geminiの3つを、実際に同じ質問を投げかけた結果をもとに整理します。

ChatGPT——学習データをもとに回答する「生成型」

ChatGPTは、学習済みのデータをもとに回答を組み立てます。ウェブをリアルタイムで検索する機能もありますが、基本的な回答は学習データに依存しています。

AI観測ラボについて質問したところ、ツールの概要や機能はおおむね正確でした。ただし有料プランへの言及はなく、情報が薄い部分も観測されました。大きなハルシネーションは確認されませんでしたが、細部の精度は学習データの質に左右される傾向があります。

Gemini——名前だけで内容を「創作」するリスク

GeminiはGoogleの検索技術と連携しているため、時事情報や最新ニュースには強い傾向があります。一方、今回の観測では、AI観測ラボについて「AIの最新ニュースを速報するメディア」という、実態とまったく異なる説明を返してきました。

「AI観測ラボ」という名前から、それらしいAIメディア像を作り上げたと考えられます。固有名詞の詳細を聞いたときに、情報が薄いほどハルシネーションが起きやすいという典型的なパターンでした。

Perplexity——ウェブ検索と生成AIを組み合わせた「検索型」

Perplexityはリアルタイムでウェブを検索しながら回答を生成します。今回の観測では、3つのなかで最も正確な回答を返しました。ツールの機能・ターゲット読者・ミッション文言まで、ほぼ正確に説明していました。

ただし、ウェブ上の情報に依存する構造は、参照元の品質に回答が左右されるという弱点でもあります。引用元が正確でも、複数ソースを統合する過程で意味が変わることがある点は、次のセクションで詳しく触れます。

| AI | 回答の正確さ | ハルシネーション | 引用元の表示 |

|---|---|---|---|

| ChatGPT | △ おおむね正確・細部が薄い | 軽微 | なし |

| Gemini | ❌ ほぼ全部間違い | 重大(別サイトを捏造) | なし |

| Perplexity | ✅ ほぼ完璧 | ほぼなし | あり |

※ AI観測ラボが2026年3月に実施した観測結果。使用モデルやタイミングによって結果は変わる場合があります。

「引用元があれば安全」は本当か

Perplexityの回答には引用元が表示されます。「出典があるから信頼できる」と感じる方は多いでしょう。ただし、引用元があることと、回答が正確であることは、別の話です。

引用元があっても間違いが起きるパターンは、主に2つあります。

ひとつ目は、引用元自体が誤情報を含む場合です。Perplexityはウェブ上のページを参照して回答を生成します。参照したページに間違いが書かれていれば、その情報がそのまま回答に混入します。出典のURLが表示されていても、元の記事が正しいとは限りません。

ふたつ目は、「出典は正しいのに結論が間違う」パターンです。複数のページを組み合わせて回答を生成する過程で、それぞれの情報がつながり方を変えてしまうことがあります。個々の引用元は正確でも、まとめた結論が事実と異なる状態になるケースです。

今回の観測では、Perplexityはほぼ正確な回答を返しました。ただし、参照するウェブページの品質に依存する構造そのものは変わりません。「引用元が出ているから大丈夫」と判断するのではなく、引用元のページを自分で開いて確認する習慣が必要です。

一方、ChatGPTやGeminiは引用元を表示しません。回答の根拠がどこにあるかをユーザー側が追いにくい分、誤りを見つけるハードルが上がります。引用元の有無は「検証しやすさの違い」であって、「正確さの保証」ではないと考えておくのが現実的です。

サイト運営者から見たハルシネーションの怖さ

ここまでは「AIの回答を読む側」の話でした。ただ、サイトを運営している立場から見ると、ハルシネーションの怖さはまったく別の角度にあります。

自分のサイトが、AIに間違って紹介されるリスクです。

今回の観測で、GeminiはAI観測ラボについて「AIの最新ニュースを速報するメディア」と説明しました。実際には、AIクローラーの解析と診断ツールを提供するサイトです。内容が全部違います。

問題は、Geminiがそれを自信満々に、整った文章で出力したことです。読んだ人がAI観測ラボに興味を持ったとしても、「AIニュースメディアを探している人」が来ることになります。求めていた情報と違うため、すぐに離脱します。サイトの中身を正確に伝えられないまま、機会だけが失われていく状態です。

さらに深刻なのは、AIの回答が「口コミ」のように広がる点です。誰かがAIに聞いた答えを、そのままSNSやチャットで他の人に共有することがあります。間違った情報が、あたかも正しい説明として流通していきます。サイト運営者が知らないところで、誤った紹介が積み重なっていく可能性があります。

加えて、AIが誤った情報を引用元として使うケースもあります。ハルシネーションを解説した記事が、別のAIの誤回答の根拠として参照されるという事例も報告されています。一度誤情報が広まると、AIが相互に参照し合う形で定着するリスクがあります。

サイト運営者にとってAI対策が必要な理由は、「AIに引用されたい」だけではありません。「AIに正しく紹介されること」も、同じくらい重要な課題になってきています。

AIクローラーへの対応方法については、「AIクローラーを拒否する前に知っておくべきこと」で詳しく解説しています。また、AIに正しく引用されるサイトの条件については、「ChatGPTに引用されるサイトの条件」もあわせて参照してください。

AIの答えを正しく使うための3つの習慣

AIの回答を完全に信じるのも、完全に疑うのも、どちらも正解ではありません。特性を理解したうえで、正しく付き合う習慣を持つことが現実的です。

習慣1:固有名詞の詳細はかならず一次ソースで確認する

人名・サイト名・会社名・サービス名など、固有名詞の詳細を聞くときは要注意です。今回の観測でもGeminiがAI観測ラボの情報を丸ごと創作しました。AIは固有名詞の「名前」は知っていても、「中身」を正確に把握していないことが多くあります。

固有名詞について調べるときは、AIの回答をそのまま使わず、公式サイトや一次ソースにあたる習慣をつけておきましょう。

習慣2:引用元が表示されたら、リンク先を自分で開く

Perplexityのように引用元を表示するAIを使う場合も、リンク先を自分で確認することが重要です。引用元のページを開いて、AIの要約と元の内容が一致しているかを確かめます。

引用元の表示は「検証するための入口」です。表示されているだけで安心するのではなく、入口として活用するのが正しい使い方です。

習慣3:重要な判断にはAIの回答を「たたき台」として使う

AIの回答は、調べものの出発点として使うのに向いています。「だいたいこういうことか」という方向性をつかむには便利ですが、重要な判断の根拠にそのまま使うのはリスクがあります。

ビジネスの意思決定、人に伝える情報、公開するコンテンツに使う場合は、AIの回答をたたき台にしながら、別の情報源で裏を取る流れを作っておくと安全です。

まとめ・今後の展望

今回の観測で、同じ質問を投げかけた3つのAIが、まったく異なる回答を返しました。PerplexityはAI観測ラボをほぼ正確に説明し、ChatGPTはおおむね正確ながら細部が薄く、Geminiは実態とかけ離れたサイト像を作り上げました。

AIの回答は「正しいか間違っているか」の二択ではありません。どのAIも、どんな質問も、同じ精度で答えられるわけではありません。質問の種類・固有名詞の有無・参照できるウェブ情報の量によって、精度は大きく変わります。

引用元の表示は「安全の証明」ではなく「検証の入口」です。自信満々な文体は「正確さの証明」ではありません。AIが整った文章で答えてくるほど、内容を疑う目を持つことが重要になります。

今後、AIの回答精度は改善されていくと考えられます。ただし、ハルシネーションがゼロになる見通しは現時点では立っていません。観測期間中は、どのAIでも誤りが発生しうる前提で使うのが現実的な姿勢です。

サイトを運営している方にとっては、「AIに正しく認識されているか」を定期的に確認することも、これからのサイト運営に必要な作業になっていくでしょう。AI観測ラボでは、サイトのAI可視性を無料で診断できるツールを提供しています。自分のサイトがAIにどう見えているかを確認したい方は、ぜひ試してみてください。

あなたのサイトは、

AIに見えていますか?

URLを入力するだけで30秒。8項目を自動診断し、優先度別の改善プランを提示します。完全無料・登録不要。