robots.txt誕生の歴史とAIクローラー時代の現実

あなたのサイトにもrobots.txtは設置してあるはずです。

でも、なぜそのファイルが存在するのか。誰がいつ作ったのか。知っている人はほとんどいません。

1994年、一人のエンジニアがメーリングリストに投稿した提案が起点でした。Googleが生まれる4年前の話です。

30年後の2026年、robots.txtはAIクローラーという想定外の存在と向き合っています。

この記事でわかること|📖:約6分

- robots.txtが生まれた1994年の背景と作った人物

- 28年間「慣習」だった事実と2022年の正式標準化

- AIクローラーがrobots.txtを無視・なりすます実態

- 2026年時点でサイト運営者が今すぐできる対策

robots.txtが生まれた日——1994年のメーリングリスト

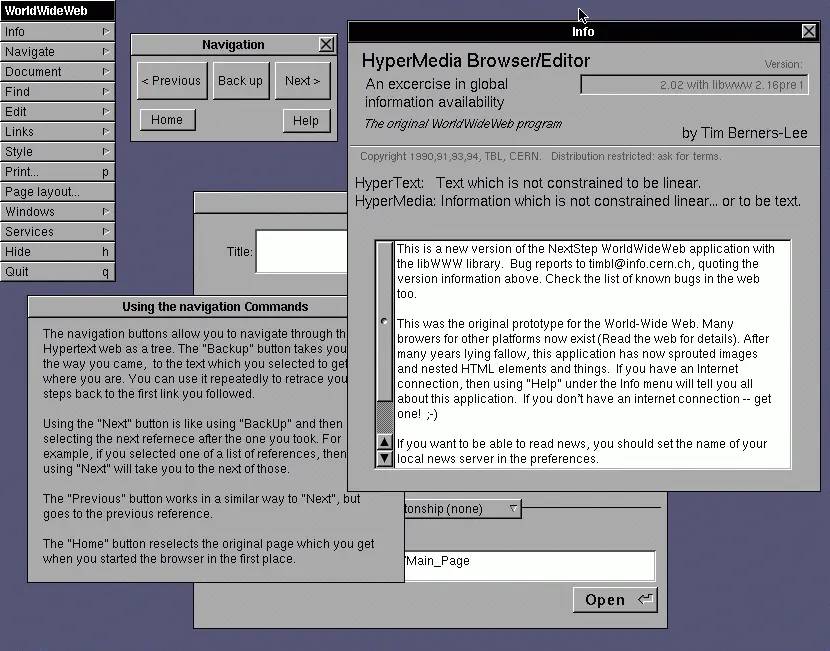

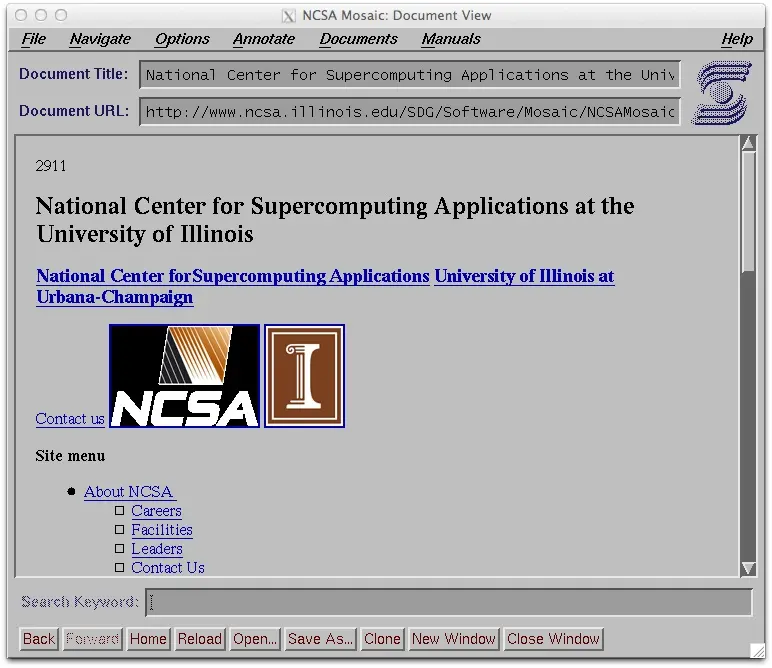

1994年2月、インターネットはまだ研究者や技術者だけのものでした。

当時、Webクローラーと呼ばれる自動巡回プログラムが急増していました。サイトを無差別に巡回するクローラーがサーバーに大量のリクエストを送りつけ、サーバーがダウンするケースが続出していました。

被害を受けた一人が、英国のセキュリティ企業Nexorに勤めるオランダ人エンジニア、Martijn Kosterでした。

Kosterはwww-talkというメーリングリストに投稿しました。当時のWebに関わる人間が全員参加していた、インターネット上の「広場」です。

投稿のタイトルは「Important: Spiders, Robots and Web Wanderers」。クローラーをサイトの特定ディレクトリから遠ざけるための、シンプルなテキストファイルを提案する内容でした。

最初の名前はRobotsNotWanted.txtでした。robots.txtという名前になったのは、DOSベースのサーバーがファイル名の長さに制限があったからです。

📌 出典

Martijn Koster本人が当時のメーリングリストのやり取りを振り返った記事が残っています。

Robots.txt is 25 years old — Martijn Koster’s Pages

提案から約4ヶ月後の1994年6月、主要なクローラー開発者たちの合意を経てrobots.txtは事実上の標準となりました。WebCrawler・Lycos・AltaVistaといった当時の検索エンジンがすぐに対応しました。

Googleが創業されるのは、この4年後の1998年です。

28年間、robots.txtはルールではなかった

robots.txtには、法的拘束力がありません。

「従ってください」というお願いを書いたテキストファイルです。従うかどうかはクローラー側の判断に委ねられています。

それだけではありません。実は2022年まで、robots.txtは正式なインターネット標準ですらありませんでした。

1994年に生まれてから28年間、robots.txtは「みんなが従う慣習」として機能してきました。GoogleもBingもYahooも、正式な取り決めなしに独自解釈で運用していました。

たとえばこんな混乱が起きていました

- crawl-delayをYandexは「秒数」、Bingは「時間窓」と解釈。Googleは無視

- Allowディレクティブは1994年の仕様に存在せず、Googleが独自に追加

- ワイルドカード(*)の動作がクローラーごとに異なる

2019年、Googleがようやく正式標準化の草案をIETFに提出しました。そして2022年、RFC 9309として正式なインターネット標準になりました。

📌 出典

RFC 9309の公式ドキュメントはこちら。

RFC 9309 — Robots Exclusion Protocol(IETF)

正式標準化まで28年かかった仕組みが、今もWebの基盤として機能しています。

想定外の存在が現れた——AIクローラーとrobots.txt

1994年にrobots.txtを設計したKosterが想定していたのは、検索エンジンのクローラーだけでした。

当時のWebは小さく、クローラーの種類も限られていました。全クローラーのリストを一人で管理できる規模だったのです。

2024年〜2026年、状況は一変しました。

GPTBot・OAI-SearchBot・ClaudeBot・PerplexityBot——AIサービスを運営する企業が次々と独自のクローラーを展開しています。目的も挙動も、従来の検索エンジンクローラーとはまったく異なります。

robots.txtを無視するAIクローラーの実態

良識的なAIクローラーはrobots.txtを遵守します。しかし現実はそう単純ではありません。

2025年8月、Cloudflareが衝撃的なレポートを公開しました。PerplexityBotが通常のブラウザに偽装し、robots.txtのブロック設定を回避してクロールを続けていたというものです。

📌 出典

Cloudflare Blog:PerplexityBotのなりすまし問題の詳細レポート

Cloudflare: AI crawlers and their impact on the web

AnthropicのClaudeBotも、robots.txtでブロック設定をしていたiFixitのサーバーに対してクロールを継続したことが報告されています。

robots.txtは「お願い」です。従うかどうかはクローラー側の判断です。1994年からその本質は変わっていません。

ただし変わったのは、「お願いを無視するクローラー」が現れたという現実です。

2026年のrobots.txtの現実

Cloudflareが2024年9月に「AIクローラーをワンクリックでブロックできる機能」を公開したところ、100万以上のサイトが即座に有効化しました。

サイト運営者の不満がどれだけ蓄積していたか、これまでの数字が物語っています。

ただし現実を整理すると、robots.txtには今も有効な使い道があります。問題は「お願いが通じない相手がいる」という前提を持てるかどうかです。

AIクローラーは大きく2種類に分かれる

| 種類 | 代表例 | robots.txt遵守 | ブロックの効果 |

|---|---|---|---|

| 学習用クローラー | GPTBot・ClaudeBot・Google-Extended | ✅ 基本的に遵守 | 🟢 有効 |

| 引用・検索用クローラー | OAI-SearchBot・PerplexityBot | ⚠️ 一部で無視・なりすましの報告あり | 🔴 限定的 |

AIに引用されたいサイト運営者にとって、引用用クローラーをブロックするのは逆効果です。一方、学習データに使われたくない場合は、学習用クローラーをブロックする意味があります。

📌 出典

Cloudflareのワンクリックブロック機能と導入状況の詳細:

Cloudflare: Declaring your AI scraping preferences

今できること——AIクローラー別robots.txt設定指針

robots.txtは「お願い」です。でも、良識的なAIクローラーはお願いを聞いてくれます。

目的別に設定方針を整理します。

AIに引用されたい場合

引用用クローラー(OAI-SearchBot・PerplexityBot)は許可しておきます。学習用クローラーだけをブロックする設定です。

User-agent: GPTBot

Disallow: /

User-agent: Google-Extended

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: OAI-SearchBot

Allow: /

User-agent: PerplexityBot

Allow: /学習データに使われたくない場合

学習用クローラーをまとめてブロックします。引用用クローラーは許可したままです。

User-agent: GPTBot

User-agent: Google-Extended

User-agent: ClaudeBot

User-agent: Meta-ExternalAgent

Disallow: /すべてのAIクローラーをブロックしたい場合

User-agent: GPTBot

User-agent: OAI-SearchBot

User-agent: ClaudeBot

User-agent: PerplexityBot

User-agent: Google-Extended

User-agent: Meta-ExternalAgent

Disallow: /⚠️ 注意

robots.txtはあくまで「お願い」です。なりすましや無視をするクローラーへの完全な対策にはなりません。サーバー負荷の軽減やWAF設定と組み合わせて使うのが現実的です。

※WAF設定:WAF(Web Application Firewall)

「悪意のあるアクセスをサーバーに届く前に止める壁」設定。

robots.txtの全ボット一覧と詳しい書き方はこちらをご覧ください。

まとめ

robots.txtは1994年、サーバーを守るために生まれました。

作った本人が想定していたのは、検索エンジンのクローラーだけでした。AIクローラーという概念すら存在しない時代の話です。

28年間ルールですらなかった仕組みが、2026年のAIクローラー時代に最前線で使われています。

「お願い」の本質は変わっていません。でも、お願いを無視する相手が現れたという現実だけが変わりました。

robots.txtを「なんとなく設定するファイル」から「意図を持って設定するファイル」に変える。それが今のサイト運営者にできる最初の一歩です。

あなたのサイトは、

AIに見えていますか?

URLを入力するだけで30秒。8項目を自動診断し、優先度別の改善プランを提示します。完全無料・登録不要。