WordPressのsitemapはAIクローラーに届いているか | 実測ログで見えた3つのパターン

AIクローラーは、毎日あなたのサイトに来ています。

サーバーログを開けば、ClaudeBotやGPTBotといった名前がずらりと並んでいます。「ちゃんと来ているな」と安心したくなる気持ちはわかります。でも、来ていることと、正しく読めていることは別の話です。

AIクローラーがサイトの全体像を把握するために最初に読むのが、サイトマップです。サイトマップを正しく渡せていなければ、AIクローラーはサイトの一部しか把握できないまま帰っていきます。

AI観測ラボのサーバーログ(2026年2月28日〜3月7日)を解析したところ、ClaudeBotが同じURL「/sitemap.xml」に8回連続で404エラーを返されていたことがわかりました。ClaudeBotは何度も同じ場所に来て、何度も空振りしていたことになります。

原因はWordPressのSEOプラグインが生成するサイトマップのURLと、AIクローラーが探しに来るURLがずれていたことでした。

同じ状況が、あなたのサイトでも起きているかもしれません。

この記事でわかること|📖:約8分

- AIクローラーがサイトマップをどう使っているか

- サーバーログで判明した3つのクローラーの動きの違い

- WordPressのSEOプラグイン別にサイトマップ URLがどう違うか

- AIクローラーに正しくサイトマップを渡す3ステップの実装方法

サイトマップとAIクローラーの関係

AIクローラーがサイトに来たとき、最初にすることは記事を読むことではありません。まず「このサイトにはどんなページがあるのか」を把握しようとします。そのときに読むのがサイトマップです。

サイトマップとは、サイト内のすべてのページURLをまとめたファイルです。地図のようなものだと考えてください。地図があれば、AIクローラーはサイト全体を効率よく把握できます。地図がなければ、リンクをたどりながら一ページずつ探し回ることになります。

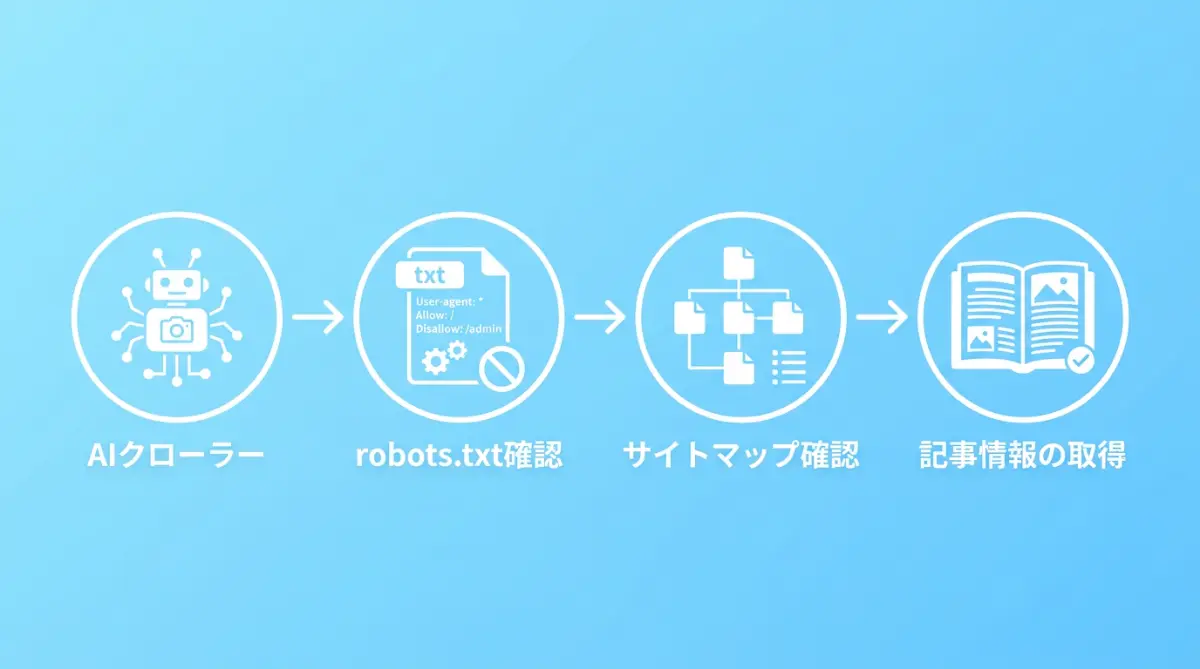

AIクローラーがサイトマップにたどり着くまでの流れは、次のとおりです。

robots.txtにサイトマップのURLが書いてあれば、AIクローラーはすぐに正しいサイトマップにたどり着けます。書いていなければ、AIクローラーは「おそらくここにあるだろう」と予測してsitemap.xmlやsitemap_index.xmlを探しに来ます。この「予測」が外れたとき、404エラーが発生します。

つまりサイトマップの問題は、ファイルが存在するかどうかだけでなく、AIクローラーが正しいURLにたどり着けるかどうかにあります。

実測ログで見えた3つのパターン

AI観測ラボのサーバーログ(2026年2月28日〜3月7日)を解析したところ、AIクローラーによってサイトマップへのアクセスパターンが大きく異なることがわかりました。

パターン1:ClaudeBot——8回空振りして、別のURLで成功

ClaudeBotは観測期間中、/sitemap.xmlに8回アクセスしました。結果はすべて404エラーです。存在しないURLに何度も来ていたことになります。

ただし、ClaudeBotが完全に迷子だったわけではありません。別のセッションでは/sitemap_index.xmlに正常にアクセスし、200レスポンスを受け取っています。つまり「/sitemap.xmlも試しに来る」という動きをしていたことがわかります。

パターン2:GPTBot——リダイレクトを使って自力で到達

GPTBotはWordPressが標準で生成する/wp-sitemap.xmlを最初に探しに来ます。AI観測ラボでは/wp-sitemap.xmlは存在しないため、301リダイレクトで/sitemap_index.xmlに転送されます。GPTBotはリダイレクトをそのまま追いかけて、正しいサイトマップに到達しています。

リダイレクト設定が機能していた好例です。

パターン3:PerplexityBot・OAI-SearchBot——サイトマップを読まない

PerplexityBotとOAI-SearchBotは、観測期間中robots.txtにしかアクセスしていません。サイトマップを読まずに別の方法でコンテンツを発見していると考えられます。

3つのパターンをまとめると次のとおりです。

| クローラー | アクセスしたURL | ステータス | 結果 |

|---|---|---|---|

| ClaudeBot | /sitemap.xml | 404 × 8回 | 空振り(別URLでは成功) |

| GPTBot | /wp-sitemap.xml | 301 → 200 | リダイレクトで到達 |

| PerplexityBot | アクセスなし | — | サイトマップを読まない |

| OAI-SearchBot | アクセスなし | — | サイトマップを読まない |

※ AI観測ラボ サーバーログ(2026年2月28日〜3月7日)の観測データをもとに作成

なぜズレが起きるのか:WPプラグイン別

ClaudeBotが/sitemap.xmlを探しに来るのは、サイトマップの標準的なURLがsitemap.xmlだという前提で動いているからです。実際、All in One SEOを使っているサイトでは/sitemap.xmlが生成されるため、ClaudeBotは正しくたどり着けます。

問題が起きるのは、YoastSEOやRank Mathを使っているサイトです。これらのプラグインはsitemap.xmlではなく、sitemap_index.xmlというURLでサイトマップを生成します。ClaudeBotが探しに来るURLと、実際に存在するURLがずれてしまいます。

WordPressのSEOプラグイン別に生成されるサイトマップのURLをまとめると次のとおりです。

| プラグイン | 生成されるサイトマップURL | ClaudeBotとのズレ |

|---|---|---|

| Yoast SEO | /sitemap_index.xml | あり |

| Rank Math | /sitemap_index.xml | あり |

| All in One SEO | /sitemap.xml | なし |

| WordPress標準 | /wp-sitemap.xml | あり |

※ 各プラグインのデフォルト設定時のサイトマップURL

日本のWordPressユーザーはYoast SEOを使っているケースが多いため、ClaudeBotが404を踏む状況が広く発生していると考えられます。

ただしClaudeBotは/sitemap_index.xmlも確認しに来るため、完全に迷子になっているわけではありません。問題は「余計な404を踏ませている」という点です。robots.txtにサイトマップのURLを明記しておけば、ClaudeBotは最初から正しいURLにたどり着けます。

実装・改善の3ステップ

AIクローラーに正しくサイトマップを渡すための対策は3つあります。難易度の低い順に紹介します。

ステップ1:robots.txtにサイトマップのURLを明記する

一番簡単で、効果が高い対策です。robots.txtにサイトマップのURLを書いておけば、AIクローラーは迷わず正しいURLにたどり着けます。ClaudeBotが/sitemap.xmlを探しに来る前に、「サイトマップはここにあります」と教えてあげる形です。

robots.txtに以下の1行を追加してください。

Sitemap: https://example.com/sitemap_index.xmlexample.comは自分のドメインに置き換えてください。Yoast SEOまたはRank Mathを使っている場合はsitemap_index.xml、All in One SEOを使っている場合はsitemap.xmlを指定します。

robots.txtはサーバーのルートディレクトリに置くファイルですが、WordPressの場合はYoast SEOやRank Mathの管理画面から編集できます。

ステップ2:自分のサイトマップURLを確認する

まず自分のサイトマップがどのURLで生成されているかを確認します。ブラウザで以下のURLに順番にアクセスして、200で表示されるURLがサイトマップのURLです。

https://example.com/sitemap_index.xml

https://example.com/sitemap.xml

https://example.com/wp-sitemap.xml確認できたURLをステップ1のrobots.txtに記載してください。

ステップ3:/sitemap.xmlへのアクセスをリダイレクトする

ステップ1だけでも十分ですが、より確実にしたい場合は/sitemap.xmlにアクセスが来たとき、正しいURLに自動転送するリダイレクト設定を追加します。ClaudeBotが/sitemap.xmlを探しに来ても、404ではなく正しいサイトマップに誘導できます。

Apacheをお使いの場合、.htaccessに以下を追加してください。

RedirectMatch 301 ^/sitemap\.xml$ https://example.com/sitemap_index.xmlexample.comは自分のドメインに置き換えてください。ConoHa WING・エックスサーバー・さくらインターネットなど主要なレンタルサーバーはApacheに対応しています。Nginxをお使いの場合はrewriteルールでの設定が必要です。

3つのステップをすべて対応すれば、AIクローラーがサイトマップで迷子になる状況をほぼ防げます。まずステップ1のrobots.txtへの1行追加だけでも、今日すぐに対応できます。

まとめ

AIクローラーがサイトに来ていても、サイトマップに正しくたどり着けているかどうかは別の話です。AI観測ラボのサーバーログでは、ClaudeBotが/sitemap.xmlに8回連続で404を踏んでいたことが確認できました。

原因はシンプルです。YoastSEOやRank Mathが生成するサイトマップのURLはsitemap_index.xmlですが、ClaudeBotはsitemap.xmlを探しに来ます。このズレを放置すると、AIクローラーは余計な空振りを繰り返すことになります。

AIは非常に効率的に動くように設計されている事実がある為、非効率なサイト=嫌われるかもしれないと思い観測ラボチーム慌てて修正致しました。

対策はrobots.txtにサイトマップのURLを1行書くだけです。今日すぐにできる対応なので、まだ設定していない場合はステップ1から試してみてください。

- robots.txtにSitemap:を明記する(ステップ1)

- 自分のサイトマップURLを確認する(ステップ2)

- /sitemap.xmlへの301リダイレクトを設定する(ステップ3)

AIクローラーへの最適化は、派手な対策より地味な設計の積み重ねです。サイトマップの整備はサイト設計においての第一歩になります。

AIクローラーが404を踏むパターンはサイトマップだけではありません。存在しないURLを推測してアクセスしてくるケースについては、こちらの記事で詳しく解説しています。

あなたのサイトは、

AIに見えていますか?

URLを入力するだけで30秒。8項目を自動診断し、優先度別の改善プランを提示します。完全無料・登録不要。